Kurz und Knapp

- Die Meinungsbildung über das Internet gewinnt an Bedeutung. Damit stellt sich auch die Frage, wie Social Bots die gesellschaftlichen Debatten beeinflussen.

- Ein Forschungsprojekt beschäftigt sich jetzt mit den Effekten von Social Bots und damit, inwieweit technische Systeme gegen sie eingesetzt werden können.

- Dabei setzt das Team maschinelle Lernverfahren ein, aber auch psychologische Experimente.

Interdisziplinäres Projekt sucht nach technischen Gegenmitteln

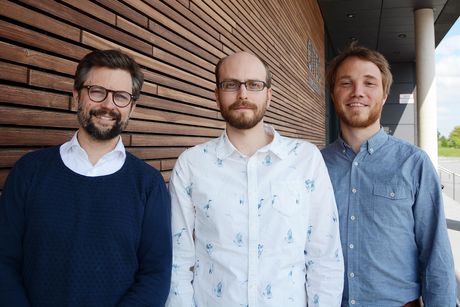

Die Wissenschaftlerinnen und Wissenschaftler beschäftigen sich unter anderem mit maschinellen Lernverfahren, um die virtuellen Roboter zu erkennen. „Die Herausforderung ist, Social Bots von anderen Accounts zu unterscheiden. Um dies in verlässlicher Weise leisten zu können, arbeiten wir in einem interdisziplinären Team aus Sozial- und Technikwissenschaften“, sagt der Soziologe Ole Pütz, Koordinator des Projekts „Unbiased Bots That Build Bridges“ (U3B).

Qualitative Methoden der Sozialwissenschaft sollen dabei mit technikwissenschaftlichen Ansätzen des maschinellen Lernens kombiniert werden; in psychologischen Experimenten wird die Wirkung von Social Bots untersucht. Zum Beispiel sollen Versuchspersonen Twitter-Beiträge danach unterscheiden, ob diese von Menschen oder Bots stammen. Zudem sollen sie beurteilen, wie überzeugend oder emotional sie einzelne Beiträge finden.

„Wir gehen davon aus, dass es eine Dunkelziffer von Profilen gibt, die bislang nicht als Bots erkannt werden. Zudem weisen aktuelle Systeme zur Bot-Erkennung noch recht hohe Fehlerraten auf“, sagt Philipp Cimiano vom Exzellenzcluster Kognitive Interaktionstechnologie (CITEC) der Bielefelder Universität, der das Projekt leitet.

Das Team, zu dem auch Florian Muhle von der Fakultät für Soziologie gehört, möchte letztlich auf Basis eines besseren Verständnisses von Social Bots und ihrer Wirkungsweisen technische Systeme entwickeln, die deren Aktivitäten entlarven. Solche Systeme könnten zum Beispiel in Wahlkampfzeiten Nutzerinnen und Nutzer warnen, bevor sie Nachrichten von Bots weiterverbreiten.

Das Projekt, bei dem die Universität und die Fachhochschule Bielefeld sowie die Australian National University in Canberra zusammenarbeiten, wird noch bis März 2020 von der Volkswagen Stiftung gefördert.

23.07.2019

in Kooperation mit dem